让龙虾看懂屏幕!谷歌多模态新成果,文本图像视频音频进同一空间

让龙虾看懂屏幕!谷歌多模态新成果,文本图像视频音频进同一空间刚刚,谷歌发布了首个原生多模态(Multimodal)嵌入模型——Gemini Embedding 2。这次模型最大的变化在于:把文本、图像、视频、音频和文档,全部映射进同一个统一的嵌入空间。

搜索

搜索

刚刚,谷歌发布了首个原生多模态(Multimodal)嵌入模型——Gemini Embedding 2。这次模型最大的变化在于:把文本、图像、视频、音频和文档,全部映射进同一个统一的嵌入空间。

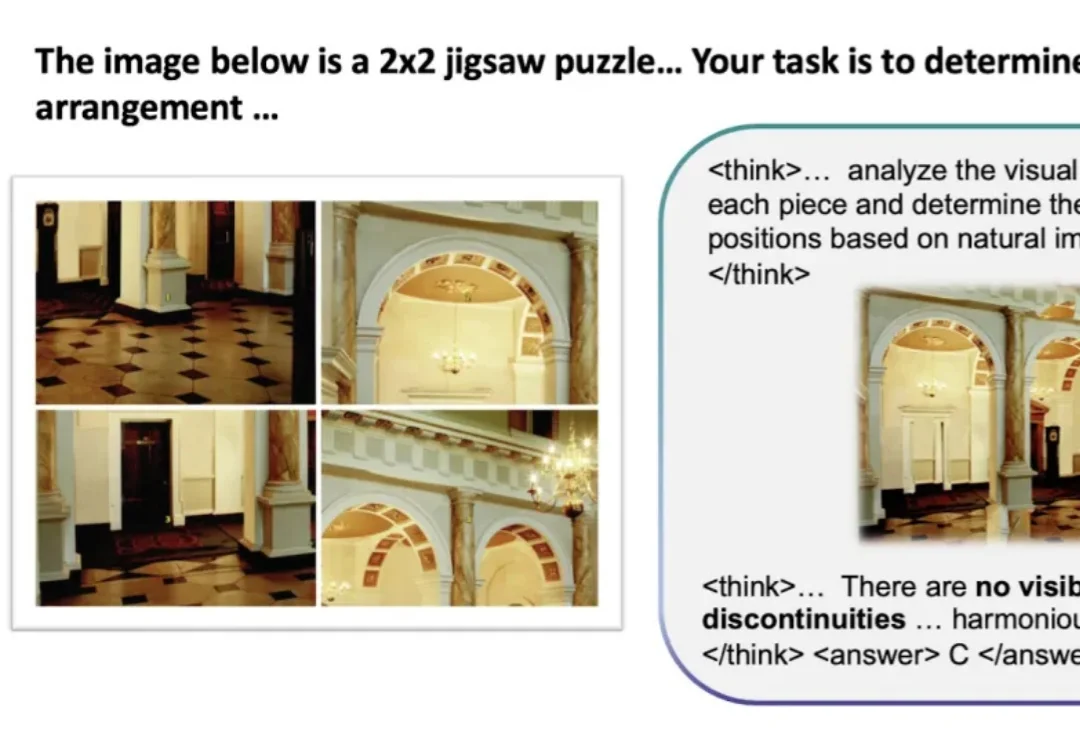

NUS、ZJU、UW、Stanford、CUHK 联合提出 「ThinkMorph」,主张让文字与图像在统一架构里「原生协作」、「共同演化」,而不是像当下大多数多模态模型那样,看完图像就闭上眼睛,后续完全靠文字链条推进。仅用 2.4 万条数据微调 7B 统一模型,视觉推理平均提升 34.74%,多项任务比肩甚至超越 GPT-4o 和 Gemini 2.5 Flash。

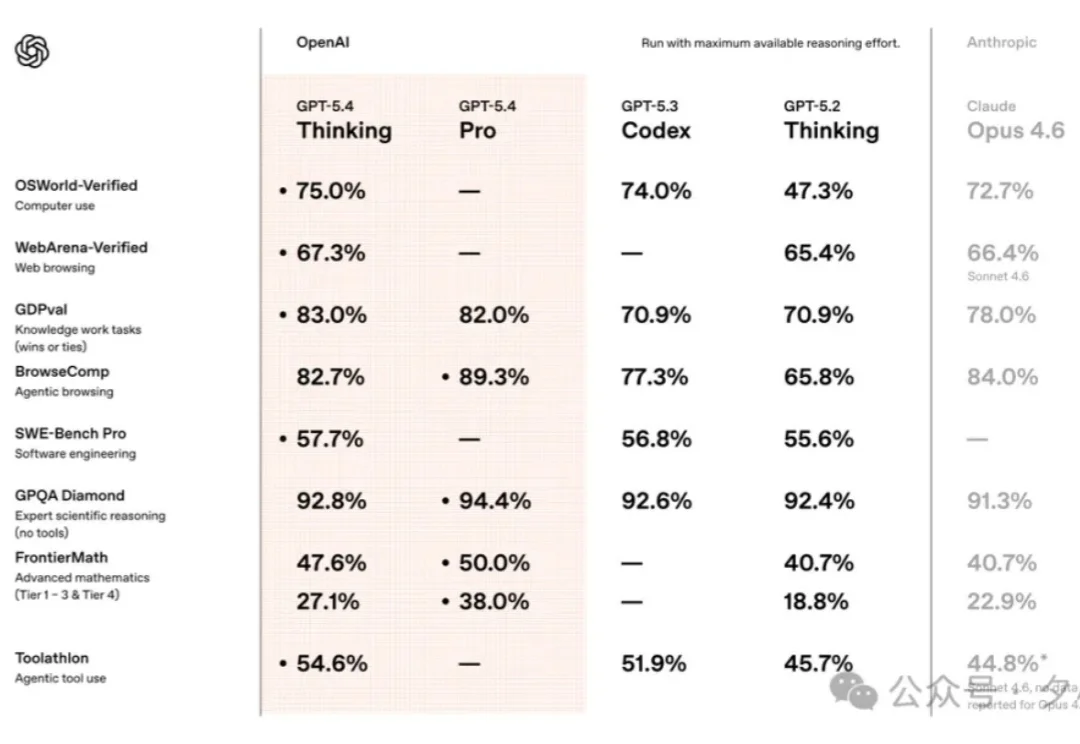

上周,GPT-5.4 发了。意图非常明显,直指 Claude Opus4.6 和 Gemini 3.1 Pro。

就在刚刚,Google Research团队用Gemini Deep Think + 树搜索框架,独立攻克了一个理论物理领域的未解积分难题——宇宙弦引力辐射功率谱的精确解析解。AI探索了600条候选路径,找出6种解法,最优雅的那条,让人类物理学家都拍案叫绝。

OpenAI深夜突袭,GPT-5.4新王炸场!一夜之间,直接粉碎了Gemini 3.1 Pro和Claude Opus 4.6的神话。这也是头一次,ChatGPT拥有真正「原生电脑使用」能力,办公效率直接拉满。而真正恐怖的地方在于,每一个维度上它都没有短板。

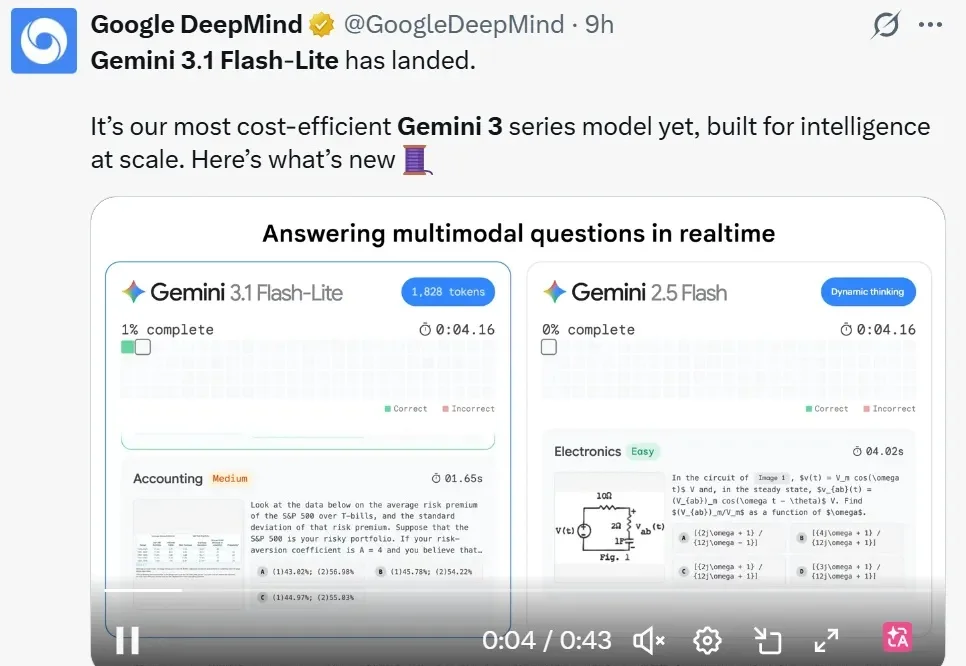

深夜,两大科技巨头谷歌和 OpenAI 硬刚起来,相继推出了新版本大模型,分别是 Gemini 3.1 Flash-Lite、GPT‑5.3 Instant。

首Token提速2.5倍,推理成绩干翻前代大模型。

全球最大游戏博主 PewDiePie,又整活了。他靠着「偷师」DeepSeek、清华大学发布的技术文档,用一堆魔改显卡成功微调出一个自己的 AI 模型,而这个模型在编程基准测试中的表现,竟然超越了 GPT-4 和 Gemini 2.5 Pro。

基于Gemini 3 Deep Think的谷歌数学智能体Aletheia在更难的挑战赛FirstProof中拿下的最佳成绩。在公布的完整成绩单中,10道题Aletheia全程0人工参与解出6道,其中5题专家全票通过,还有一题拿到了5/7的通过率。

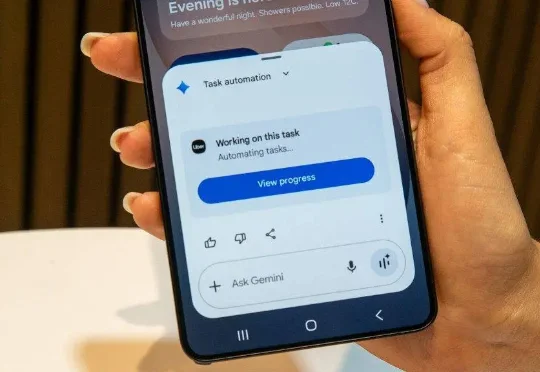

原本以为,三星 Galaxy S26 系列早已被曝光,发布会也就走个流程。没想到三星和 Google 还藏了一手。 两家公司共同展示了 S26 搭载的全新 Gemini 智能体能力:口头吩咐一句话,G